안녕하세요, HELLO

오늘은 DeepLearning.AI에서 진행하는 앤드류 응(Andrew Ng) 교수님의 딥러닝 전문화의 두 번째 과정인 "Improving Deep Neural Networks: Hyperparameter Tuning, Regularization and Optimization"을 정리하려고 합니다.

"Improving Deep Neural Networks: Hyperparameter Tuning, Regularization and Optimization"의 강의 목적은 '랜덤 초기화, L2 및 드롭아웃 정규화, 하이퍼파라미터 튜닝, 배치 정규화 및 기울기 검사와 같은 표준 신경망 기술' 등을 배우며, 강의는 아래와 같이 구성되어 있습니다.

~ Practical Aspects of Deep Learning

~ Optimization Algorithms

~ Hyperparameter Tuning, Batch Normalization and Programming Frameworks

"Improving Deep Neural Networks" (Andrew Ng)의 2주차 "Optimization Algorithms" 연습 문제입니다.

□ CHAPTER 1. 'Optimization Algorithms 연습문제'

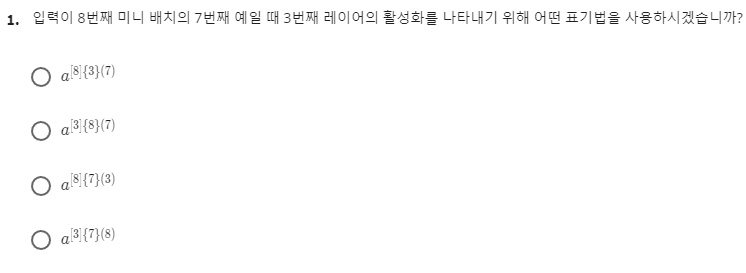

■ 질문 1

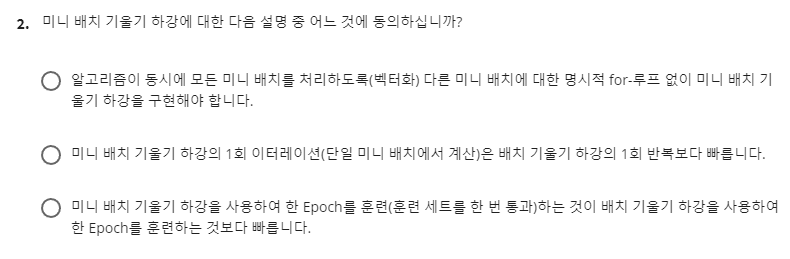

■ 질문 2

■ 질문 3

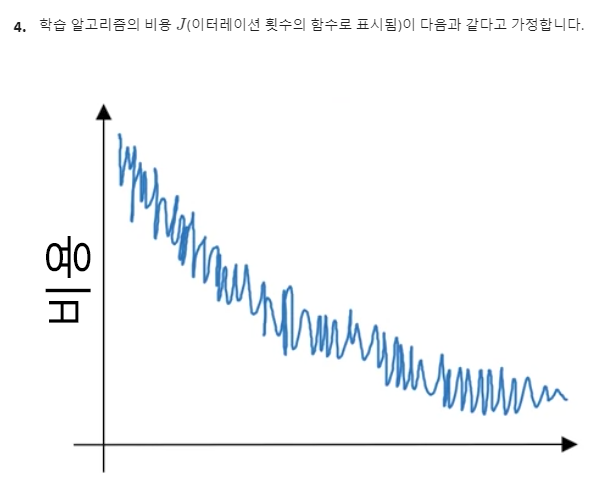

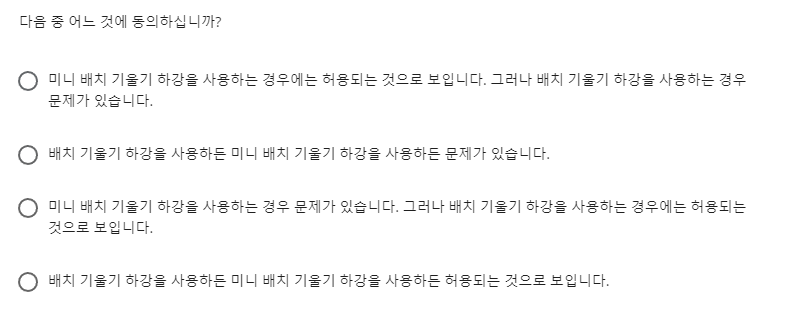

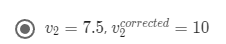

■ 질문 4

■ 질문 5

■ 질문 6

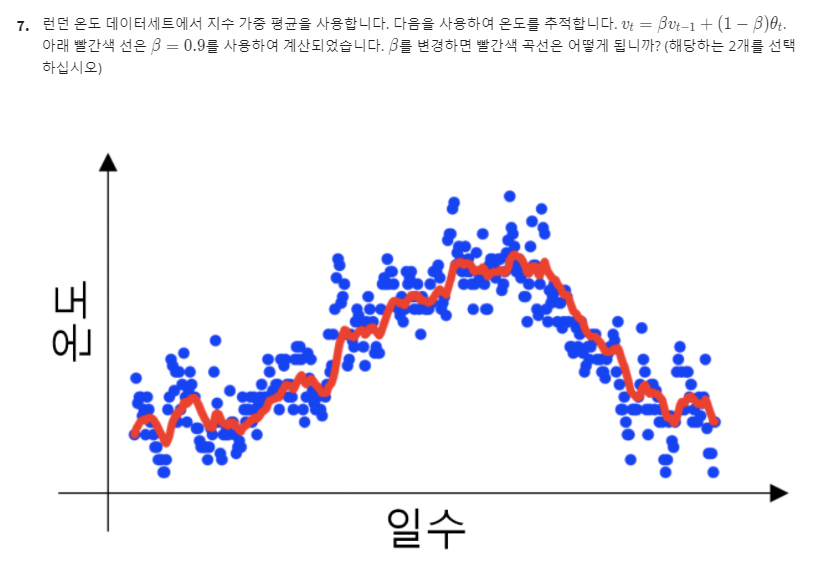

■ 질문 7

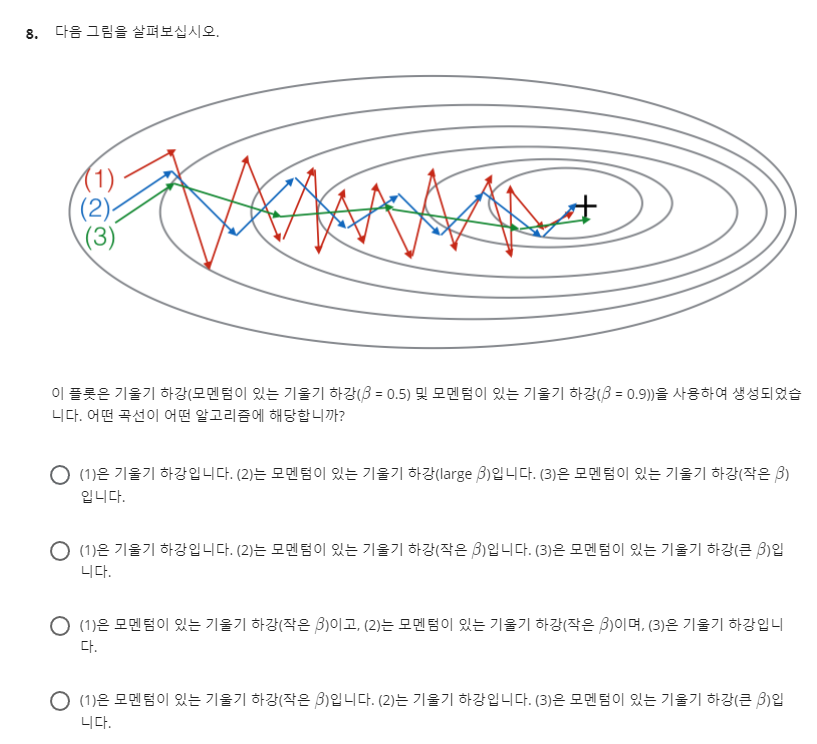

■ 질문 8

■ 질문 9

■ 질문 10

■ 마무리

"Improving Deep Neural Networks" (Andrew Ng)의 2주차 "연습 문제"에 대해서 정리해봤습니다.

그럼 오늘 하루도 즐거운 나날 되길 기도하겠습니다

좋아요와 댓글 부탁드립니다 :)

감사합니다.

'COURSERA' 카테고리의 다른 글

| week 3_Hyperparameter Tuning, Batch Normalization (Andrew Ng) (0) | 2022.02.24 |

|---|---|

| week 2_Optimization Methods 실습 (Andrew Ng) (0) | 2022.02.20 |

| week 2_Optimization Algorithms (Andrew Ng) (0) | 2022.02.20 |

| week 1_Gradient Checking 실습 (Andrew Ng) (0) | 2022.02.18 |

| week 1_Regularization 실습 (Andrew Ng) (0) | 2022.02.18 |

댓글